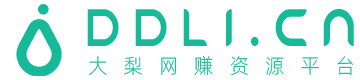

今天你点进 Claude 的时候,会看到这样一个弹窗:

这是 Claude(Anthropic 的 AI 助手)今天更新了用户条款和隐私政策:

允许 Claude 使用你的聊天内容和编程会话,用于训练和改进 AI 模型。

默认是“同意”,可以手动去设置关闭。而且是要求用户在 2025 年 9 月 28 日前作出选择。

你或许以为「Not now」是拒绝,其实只是「先别选」。但只要你一直不选,到 9 月 28 日,它大几率就会卡住你,强制你点一个。

这还叫“征求意见”吗?这分明就是“你不反对,那我就上了”。

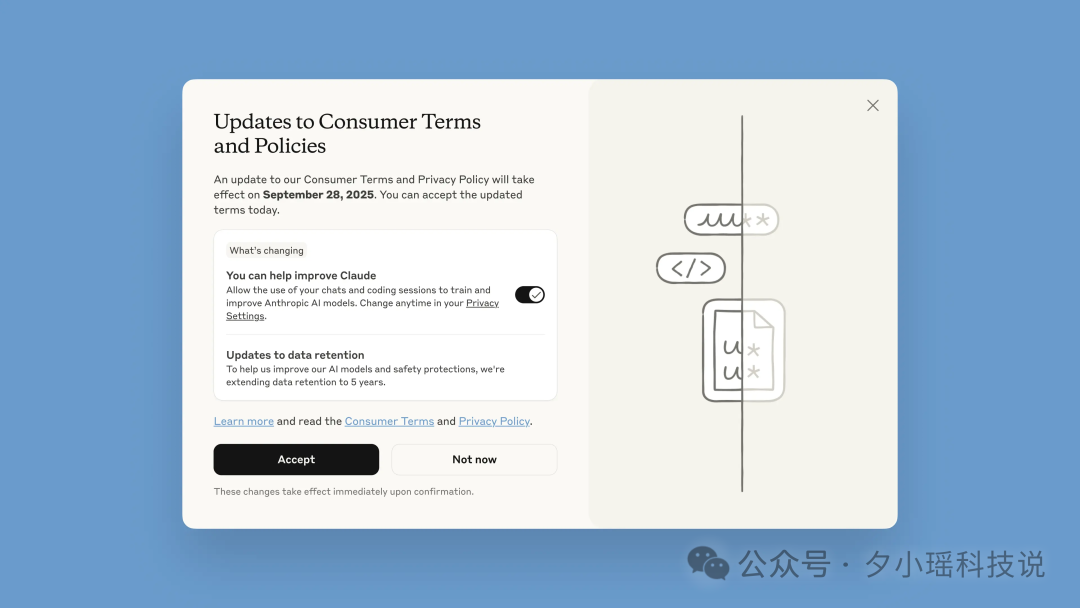

如果你同意了,你的聊天数据会被保留 5 年,拿来给未来的 Claude 进化用。如果不同意,不好意思,只能保留 30 天,还可能用于安全审查或“匿名研究”。

这个计划不是针对免费的 Claude 用户,就连 Pro 和 Max 的付费用户也被计划进去了。

如果你是 Claude 的老用户,你一定记得,它最早最大的卖点就是「安全」。

Anthropic 的每一篇博客、每一个采访都在强调:Claude 不会用你的数据训练模型,也不会偷偷记住你讲过的话。

在这个谁都想抓住用户信息不放的 AI 时代,它是那个看起来最像“干净人”的产品。

但从今天起,它变了。

变得和其他家的产品一样,在模型背后悄悄运转一个又一个数据磨坊。

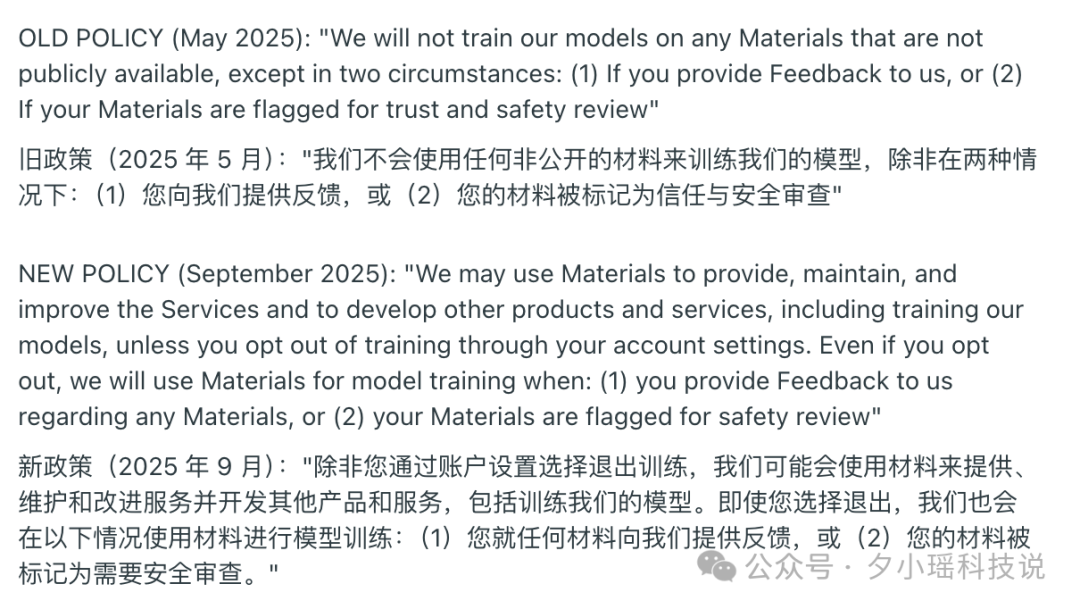

还有 Google,也在 9 月 2 日默认开启 Gemini 的数据训练收集机制,连用户上传的截图、视频、音频都能抓进来。

Meta 更是早就把「个性化记忆」变成 AI 默认开关,甚至通过 AI 聊天记录间接推断用户的性取向、心理状态和身份习惯。

而且,相比之下 OpenAI 最起码还保留了「默认关闭」的设置,而 Anthropic 这次,是明晃晃地把开关掰到了「默认打开」。

一个本来主打「AI 安全」的公司,开始像所有不安全的公司一样行动了。

它说自己是在为了“让 AI 更安全”,所以才要用真实数据训练。

但它没有告诉你的是:这份安全,是以牺牲你的透明权、控制权、删除权为代价的。

它说我们不卖数据。但它也没有告诉你,它可以把你的数据放进任何一个 AI 实验室、研究系统,甚至用于“AI 社会影响研究”这种模糊词条中。

这不仅仅是功能更新,这是一次价值观上的投降。

如何在最高程度上保护我们的隐私?

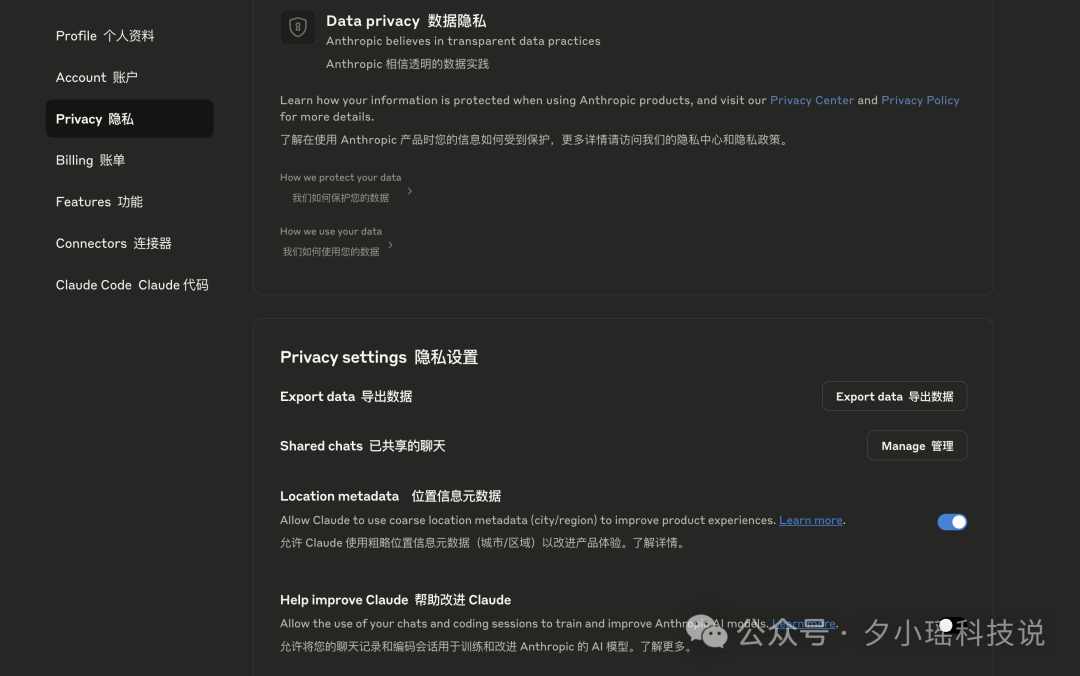

大家看到这个弹窗,可以先点「accept」,但是现在别恢复任何聊天。立刻去「 settings」 >「 privacy」 > 找到「privacy settings」中的「help improve Claude」关掉它 ,然后随便做点别的,你就能回到安全模式了。

哎,其实看完 Anthropic 的整篇博客,我的第一反应居然是:我好像已经习惯了。

从互联网时代开始,我们的数据就从来不是属于我们的。

我们用搜索引擎,它记下我们搜了什么;我们刷社交,它知道我们几点刷到哪张脸多看了两秒;我们在购物车里犹豫,它已经帮我们算好下个月的广告该怎么投了。

数据的生产权在你,使用权不在你。

文章来自于微信公众号“夕小瑶科技说”,作者是“R.Zen”。